「INFO」连接音乐音频与自然语言

博主用Claude Code将ISMIR 2024上的一篇高质量教程翻译为中文版,并呈现在Github Pages上,方便读者阅读。

📖 https://beiciliang.github.io/intro2musictech/music-language-tutorial

@book{connecting-music-audio-and-natural-language:book,Author = {Doh, SeungHeon and Manco, Ilaria and Novack, Zachary and Kim, Jong Wook and Chen, Ke},Publisher = {https://mulab-mir.github.io/music-language-tutorial},Title = {Connecting Music Audio and Natural Language},Year = 2024,Url = {https://mulab-mir.github.io/music-language-tutorial},}

『教程内容』

✎ 第一章 引言

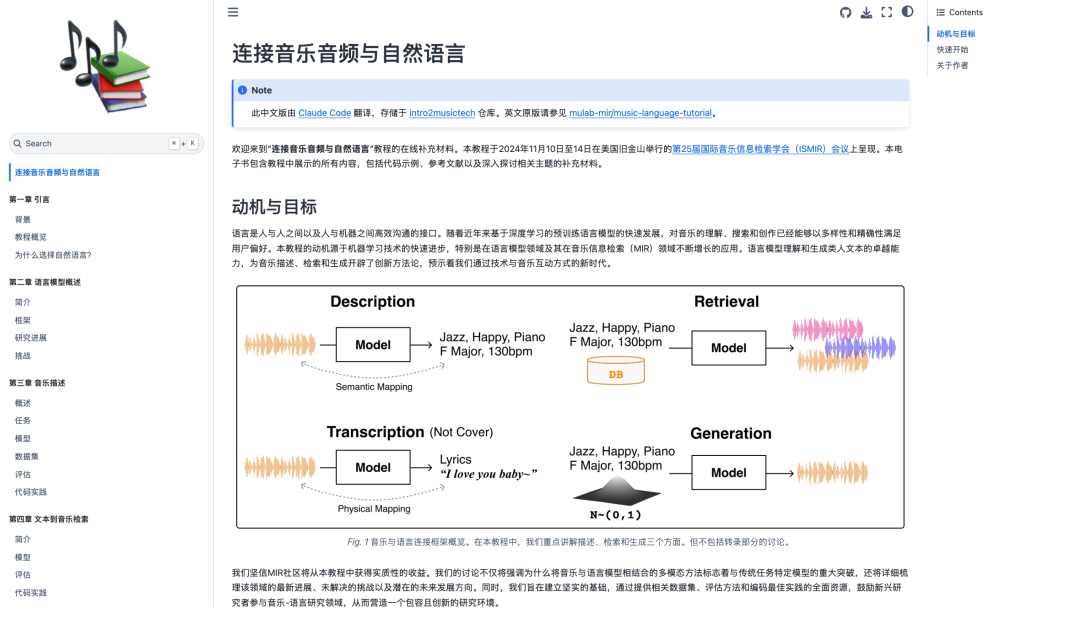

介绍语言模型在音乐信息检索(MIR)领域的研究背景与发展脉络。回顾早期基于监督分类的音乐标注与检索方法,分析其固定词汇表、独热编码等局限性。概述本教程的整体框架:从语言模型基础出发,依次探索音乐描述、检索与生成三大方向。同时展示语言模型如何推动音乐理解从简单分类走向自然语言交互。

✎ 第二章 语言模型概述

系统介绍语言模型的核心概念,包括分词策略(BPE、SentencePiece)、掩码语言模型(BERT)和自回归语言模型(GPT)等范式。深入讲解将非文本输入融入语言模型的多种条件化方法:自适应调制、通道拼接、前缀条件化和交叉注意力机制。梳理迁移学习、零样本推理、缩放定律、RLHF 对齐、检索增强生成(RAG)、工具调用及多模态编解码器等前沿进展。同时讨论幻觉、偏见、计算成本、上下文长度限制等尚未解决的挑战。

✎ 第三章 音乐描述

涵盖从传统音乐分类(流派、乐器、情绪标签)到自然语言描述生成(音乐字幕)的完整任务谱系,并延伸至音乐问答和对话式描述等新兴交互范式。对比编码器-解码器架构与适配大语言模型(LLM)两大主流建模方案的优劣,附带详细的模型对照表。介绍BLEU、METEOR、BERT-Score 等自动评估指标及其局限性,以及 MuChoMusic、OpenMU 等专为音乐理解设计的新基准。提供基于真实数据集的代码实践环节。

✎ 第四章 文本到音乐检索

从基于分类的布尔检索出发,引出词汇表外(OOV)问题,进而介绍音频-文本联合嵌入这一核心解决方案。详细讲解多模态度量学习中的三元组损失与对比损失,以及从静态词嵌入(GloVe)到上下文化表示(BERT/RoBERTa)的演进。讨论当前面临的三大挑战:查询与描述的分布偏差、训练数据局限于内容属性而忽略文化与元数据维度、单轮检索无法保持上下文。展望对话式音乐检索如何通过多轮交互和用户反馈实现更自然的搜索体验。

✎ 第五章 文本到音乐生成

回顾从算法作曲到神经音频合成的发展历程,聚焦文本到音乐生成的两大技术路线。深入剖析 MusicGen 的自回归方案:利用 Encodec 将音频离散化为 token,再通过 Transformer 逐步生成。对照介绍扩散模型方案的数学基础(SDE、分数函数)、音频表示策略(波形、梅尔频谱、潜空间)以及 U-Net 与 DiT 架构。涵盖主观评估(MOS、MUSHRA 听力测试)和客观评估(FAD、CLAP Score)等完整的评价体系,并提供代码实践。

✎ 第六章 总结

总结全教程的核心知识脉络,回顾从监督分类到大语言模型驱动的范式演进。探讨超越文本控制的未来方向:音频到音频的控制(伴奏生成、音色迁移、迭代编辑)以及基于强度、旋律、和弦等抽象音乐属性的精细化控制。指出文本作为控制媒介在表达细粒度音乐细节方面的固有局限,展望更直觉化的音乐创作交互方式。

『网页配置』

为了呈现该教程,GitHub Pages 配置如下:

-

部署方式:legacy(经典模式,非 GitHub Actions)

-

源分支:gh-pages,根目录 /

工作原理:每次向 gh-pages 分支推送新的提交,GitHub 会自动触发部署,将该分支根目录下的所有静态文件发布到站点。因为根目录有 .nojekyll 文件,GitHub 跳过 Jekyll 构建,直接原样部署所有文件(包括以 _ 开头的目录如 _static/、_images/)。

当前 gh-pages 分支结构:

gh-pages/├── .nojekyll # 禁用 Jekyll,直接部署静态文件├── index.html # 首页,教程卡片列表├── MIR-CC.html # marimo 教程的静态导出└── music-language-tutorial/ # Jupyter Book 渲染的完整站点├── intro.html # 教程首页├── introduction/ # 第一章├── lm/ # 第二章├── description/ # 第三章├── retrieval/ # 第四章├── generation/ # 第五章├── conclusion/ # 第六章├── bibliography.html # 参考文献├── _static/ # CSS/JS/字体等静态资源└── _images/ # 图片资源

更新流程:在 main 分支用 Jupyter Book v1 构建 → 切换到 gh-pages → 复制构建产物 → 提交并推送 → GitHub 自动部署。

☞ 如果你想帮助博主更新,欢迎发起Pull Request!

如果还有哪些高质量MIR相关教程值得英译中,欢迎留言!

上文回顾:「MIR-CC」2026年用Claude Code就可以无痛入门音乐科技

点击下方阅读原文可直达教程索引

☞ https://beiciliang.github.io/intro2musictech